A OpenAI revisou, em 3 de março de 2026, os termos de seu polêmico acordo com o Departamento de Guerra dos EUA, apenas 24 horas após o anúncio inicial que provocou uma migração expressiva de usuários do ChatGPT nos Estados Unidos.

A empresa, avaliada em US$ 730 bilhões após uma rodada de financiamento liderada por Amazon e Nvidia, justificou a revisão diante da pressão pública e da crise de confiança que se instalou no setor de IA militar.

O anúncio inicial desencadeou um êxodo de usuários civis: as desinstalações do ChatGPT subiram 295% e as avaliações de uma estrela na App Store cresceram de forma alarmante, abrindo espaço para o Claude, da Anthropic, que registrou um aumento de 51% nos downloads no fim de semana seguinte e, pela primeira vez, superou o ChatGPT em instalações diárias.

A Anthropic recuou, recusando o acordo com o Pentágono, e o governo designou a empresa como risco à cadeia de suprimentos, situação que por um lado reforçou a reputação ética da Claude entre usuários preocupados com aplicações militares de IA.

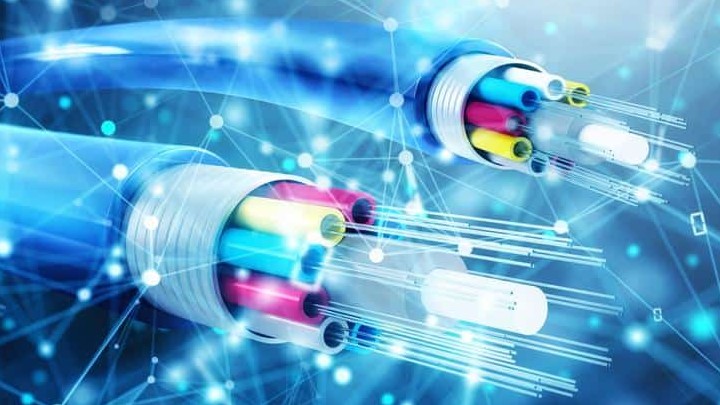

Na nova versão do acordo, a OpenAI incluiu salvaguardas controversas: proibição de uso da tecnologia para vigilância doméstica em massa, armas autônomas e decisões automatizadas de alto risco sem supervisão humana; além disso, agências de inteligência como a NSA não poderão usar os serviços da OpenAI sem um acordo separado e os dados comercialmente adquiridos não poderão ser usados com fins de vigilância.

Especialistas veem o caso como um marco para governança de IA em TI, destacando que empresas podem escolher entre contratos governamentais lucrativos e ética pública; a migração para Claude pode sinalizar a emergência de um ecossistema paralelo, com implicações para privacidade, conformidade regulatória e segurança de dados.

![[AS2716] Universidade Federal do Rio Grande do Sul](https://r2.isp.tools/images/asn/2716/logo/image_100px.png)

![[AS52888] Universidade Federal de São Carlos (4 probes)](https://r2.isp.tools/images/asn/52888/logo/image_100px.png)